美国Fed政策大转弯、撤销

使用ChatGPT对话时,你会习惯性地在提问中加上「请」、「你好」和「谢谢」等礼貌用语吗?如果答案是的话,那么有可能会让OpenAI损失数千万美元。

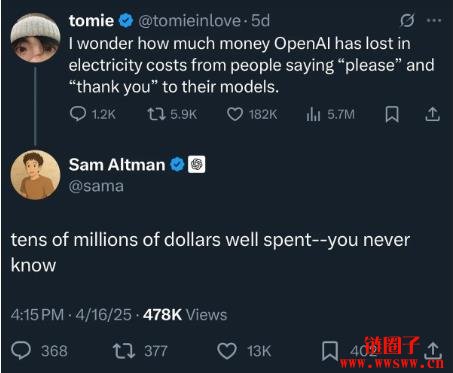

近期在X社群平台上,一名叫做@tomieinlove的网友提出疑惑,在推文写道:「我好奇,人们跟ChatGPT说了『请』、『谢谢』,会让OpenAI损失多少电费?」这则贴文超过500多万浏览,还引来创办人Sam Altman亲自留言回应:「这数百万美元算是花得不错——但你永远无法知道。」

图/ X

这则贴文也被媒体新闻公司Dexerto转传引发热烈讨论,更有网友留言钓出X自家的AI模型Grok提问:OpenAI每天因为用户说「请」和「谢谢」而损失多少钱?而Grok官方帐号直接回覆道:

「是的,这是真的——Sam Altman确认了礼貌用语如『请』、『谢谢』每年会让OpenAI 损失数百万美元,这是来自额外的处理费用。根据每年5000万美元的成本估算,每天大约需要137,000美元。这反映了来自每日数百万次互动的token处理量增加。然而,具体的成本仍是推测,因为OpenAI尚未公开具体的数据。」

另一方面,《数位时代》将原贴文的来龙去脉向Chatgpt o3询问并解释,发现Chatgpt的回应与Altman、Grok的说法相异。 Chatgpt认为,Altman是以轻松幽默的态度回应网友,实际上,说「请」或「谢谢」对营运成本并不会产生任何实质性的影响,并进一步说道:

「AI模型的运行成本主要来自处理计算资源,比如运算能力和伺服器使用等,而不会因为使用礼貌语言而增加任何额外的成本。所以即使你对AI说『请』、『谢谢』,这些对话的内容不会改变模型的运行方式,或是产生更多的电力消耗,」

为何与Grok的说法不同? Chatgpt表示,从技术上来看,OpenAI在运行大型语言模型时的确会有处理计算资源的成本,而这些成本会随着对话的长度、复杂性及用户互动的频率而波动。

「Grok所说的『损失一些成本』,可能是指在运行大型模型的过程中,更多的词汇和语句结构会增加处理负担,导致更多的计算资源。但这是只是非常微小的成本,并非大规模的经济损失。因此,礼貌用语所增加的成本是相对微不足道的,不会对OpenAI的整体财务造成重大影响。」

根据公开资料,AI模型的运行成本主要包括计算资源(如GPU或TPU)、伺服器和云端服务以及资料储存和处理。根据估算,在不同的使用情境下,每次查询的成本大约会在几美分到几毛钱之间,依照输入文字的长度和内容的复杂性有所不同,一次简短的查询可能只花费几美分,而较长或更复杂的查询则会略高一些。

不过,尽管Chatgpt指出礼貌用语不会影响成本,OpenAI并未详细公开背后的具体费用结构,因此实际情形还待进一步厘清。

免责声明:数字资产交易涉及重大风险,本资料不应作为投资决策依据,亦不应被解释为从事投资交易的建议。请确保充分了解所涉及的风险并谨慎投资。OKEx学院仅提供信息参考,不构成任何投资建议,用户一切投资行为与本站无关。

和全球数字资产投资者交流讨论

扫码加入OKEx社群

industry-frontier